AWSユーザーでありながら使っていないアーカイブバックアップサービスのGlacierを使用してみることにしました。

うまいこと使えば現実的な金額での写真の保管が出来そうだなあと思いました。

Amazon S3 Glacierとは

そもそもAWSを使っていないユーザーがいるとは思うので軽く触れますと、Amazonが使用しているクラウドのストレージサービスになります。冗長性や耐久性がとても高く、よっぽどのことが無い限りは安全なので、企業でも採用するところが多いです

今回使用するのはS3の機能の中でもアーカイブデータの保管に優れたAmazon S3 Glacier(以降はGlacier)を使用します。取り出しに時間がかかる分安いのがS3と異なりますね。

前までは画面上での操作が出来なく、取り出し料金が結構掛かるので避けていましたが、S3の一部となってからは比較的ラクになったみたいなのでこれを機につかうことにします。

こちらでもう少し詳しく書きましたが、だいたい内容は同じです。

コスト面の試算

Glacierも取り出しにかかる時間によってGlacierとGlacier Deep Archieveの2つに別れます。データ保管の料金ですが東京リージョンでの価格だとこんな感じになります。

*2020年7月現在。価格は改定されますので最新のを確認してください

*データ移行にかかる料金などは今回除外しています。実際にはもう少しかかりますが、そこまで変わらないと思っています。

東京リージョン

・S3標準:0.025USD/GB(最初の50TBのみ)

・Glacier:0.005USD/GB

・Glacier Deep Archive:0.002USD/GB

うちにある写真データは大体2TBぐらいなのでそれぞれ月額50ドル・10ドル・4ドルとなります。

S3は即時で取り出せる分、高額になっていますね。

一方でリージョンでも価格差があり、最も安いアメリカだとこうなります。

米国リージョン(北カリフォルニアを除く)

・S3標準:0.023USD/GB(最初の50TBのみ)

・Glacier:0.004USD/GB

・Glacier Deep Archive:0.00099USD/GB

同様に月額になおすと46ドル・8ドル・1.98ドルとなります。

単純に保管だけでいいなら年間3000円ほどの料金でなんとかなります。

S3の耐久性は99.999999999%(イレブンナイン)なので、自宅のHDDで管理するよりも消える確率は低いです。Amazonが死ぬか、リージョン(この場合はアメリカ)が潰れない限り残りますね。

自分はAmazonに魂売ってるので信じて写真データを保管してみることにします。

実際に作成して保管してみる

AWSのアカウントを持っていることを前提にすすめてみます。

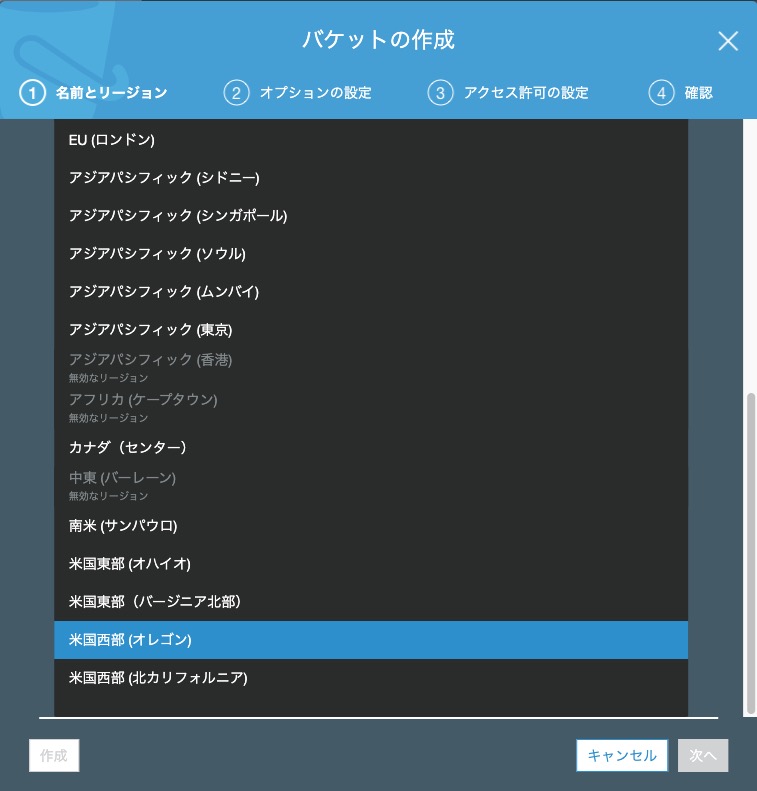

S3のコンソール画面から新規バケットを作成

ここではテスト用に使用するので「test」みたいなのを名前につけます。

S3のバケットは世界唯一の名前にしないといけないので単純な名前だと弾かれます。

リージョンの選択をします。普段でしたら東京リージョンを選択しますが、なるべく安くしたいので米国のを使用することにします。

基本的にはどこでもいいのですが、米国西部:北カリフォルニア(us-west-1)のみ$0.002/GBなので注意が必要です。今回は米国西部:オレゴン(us-west-2)を選択します。

us-eastを選ばなかったのはデータセンターが逝く回数があまりに多いので。

色々な設定を求められますが、そこまでの使い方をするわけではないので、今回は全部無視します。バケットを非公開にするぐらいでしょうか。

スキップしまくると作成できますので、S3バケットが作成されます。このままGlacierへアップロードしていきます。

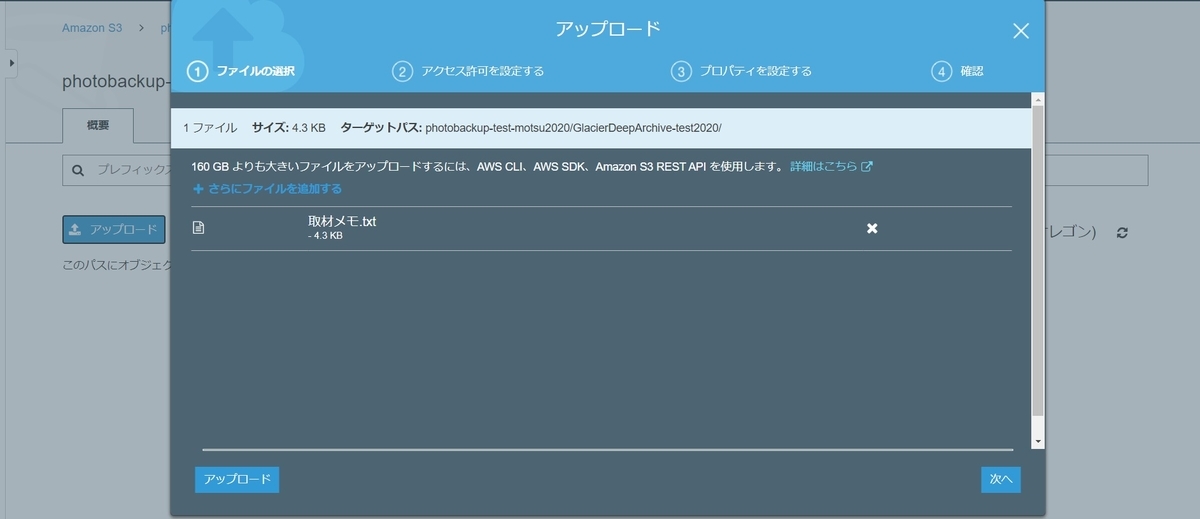

Glacierへアップロードする

バケット内でフォルダを作成します。今回はGlacierのテストなので適当なフォルダ名にします。

アップロードはドラッグ・アンド・ドロップで出来ますので、適当なファイルを入れます。

写真の場合は日付でリネームしたzipファイルだと後々管理が楽かなと思います。

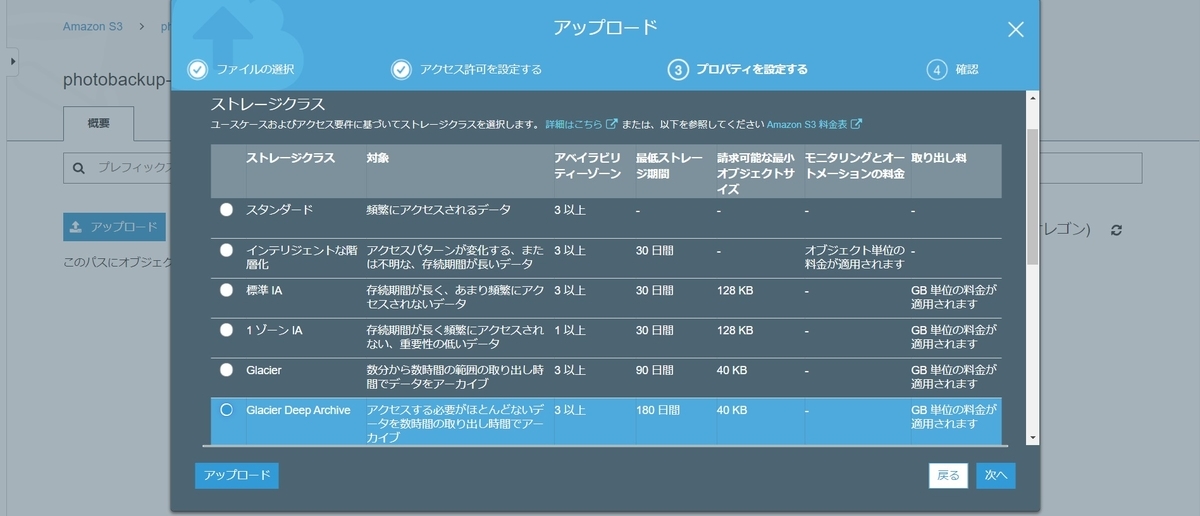

アップロードするときにストレージクラスを選択します。

今回はアーカイブの中でもほとんど取り出さないつもりなのでGlacer Deep Archiveを選択します。

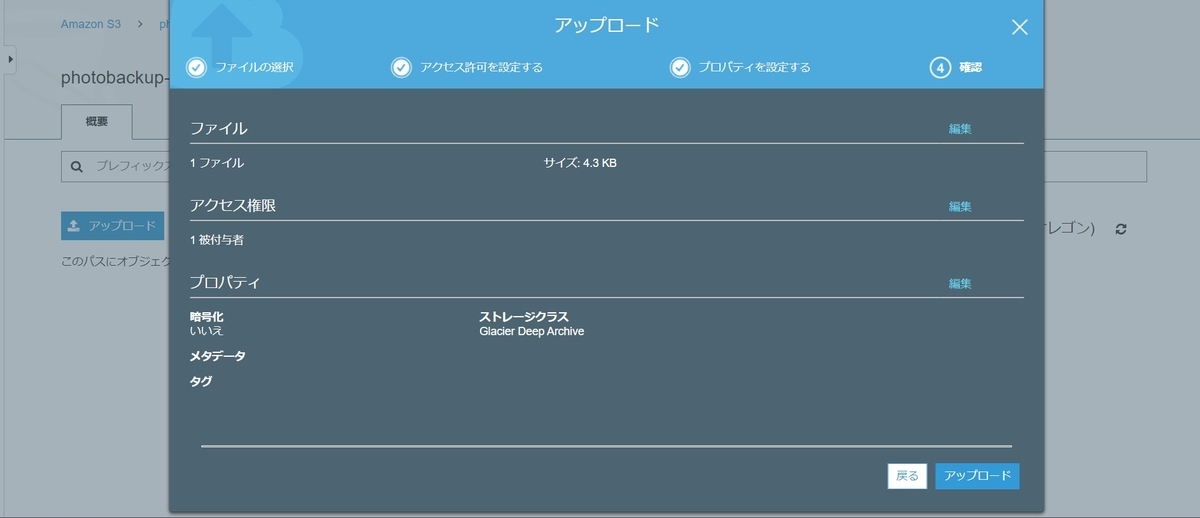

そのままアップロードを押すとファイルがアップロードされます。これで完了になります。

ストレージクラスもちゃんとGlacer Deep Archiveになっていますね。

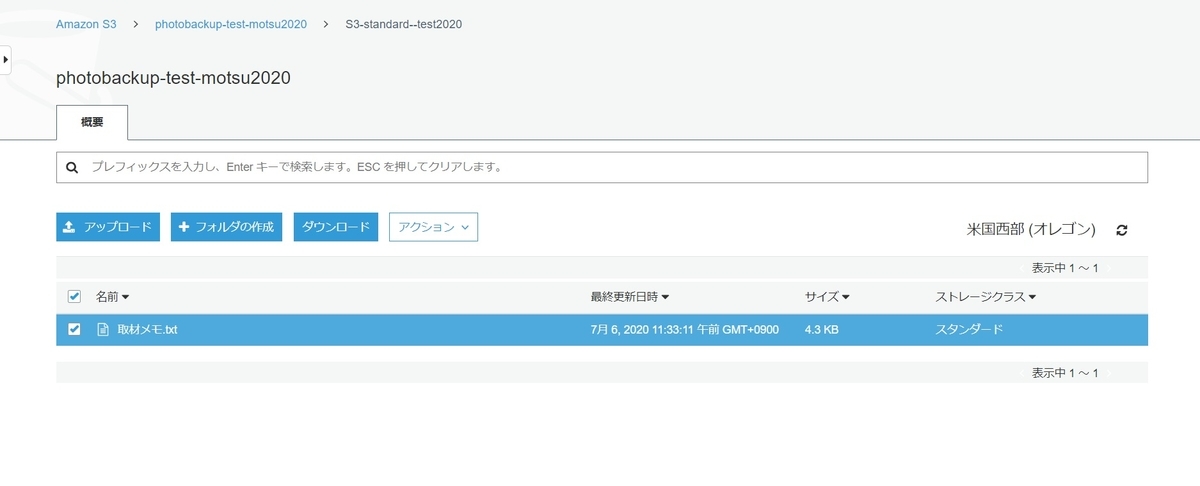

今のテスト環境のバケットです。S3の標準でも同様に作成をしてみました。

中身を確認するとストレージクラスがスタンダードになっています。

保存したファイルをダウンロード(復元)する

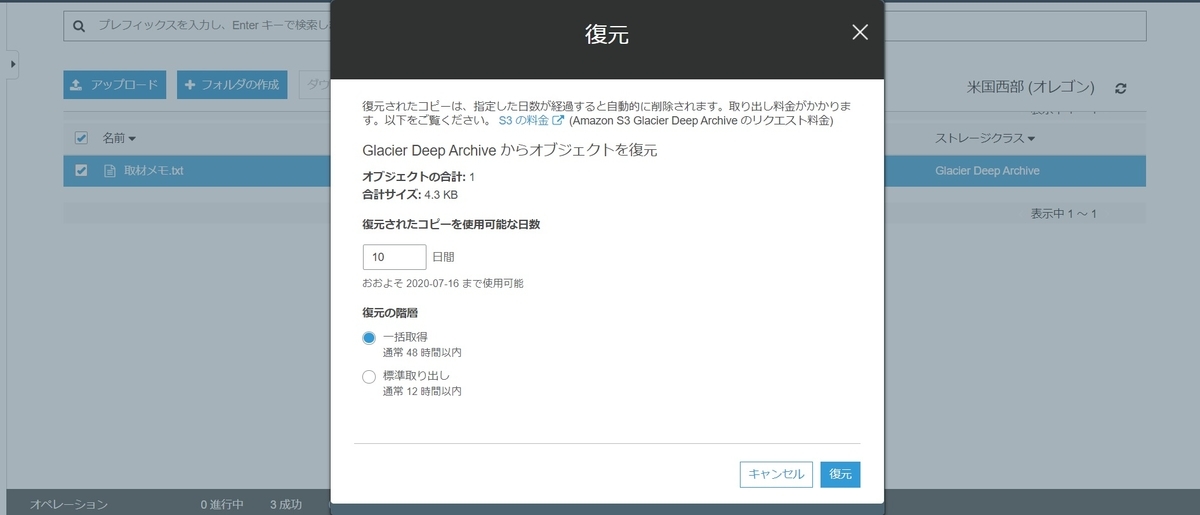

Glacierからファイルの復元依頼を出します。

即時でダウンロードできないので、アクションの「復元」を選択し、何日ほど使用可能にするのかを設定します。この日は適当でも問題ないです。

あとは取り出しにかかる時間を待つだけです。最大2日も待てばいいのであとは気長に待ちましょう。

ちなみにS3の標準だと即時でダウンロードが出来ます。もちろんその分の料金はかかるので使い方によって分けましょう。

まとめ:個人にもよるけど結構使えるかも

TB単位の資源を年間3000円ほどで保管出来ることがわかりました。CUIでの操作は必要無いので、なれてしまえば簡単にアーカイブバックアップが出来ますね。

取り出しに時間がかかること、その時に料金が発生してしましますが、大事なデータはほぼ確実に残るのならば選択肢としてありなのではないでしょうか。

こうした内容は技術系のブログに書く予定だったんですが、写真に関わることなのでこっちにも書いています。

参考資料